Quản lí ghi nhớ và bối cảnh dài hạn (tiếp tục)

Sử dụng bộ nhớ hạn chế token

+ Các hệ thống ghi nhớ như ConversationTokenBufferMemory theo dõi sử dụng token và cắt ngắn các thông điệp cũ một

khi một ngưỡng được đi đến

+ Cái này đảm bảo các hạn chế token của LLM được coi trọng.

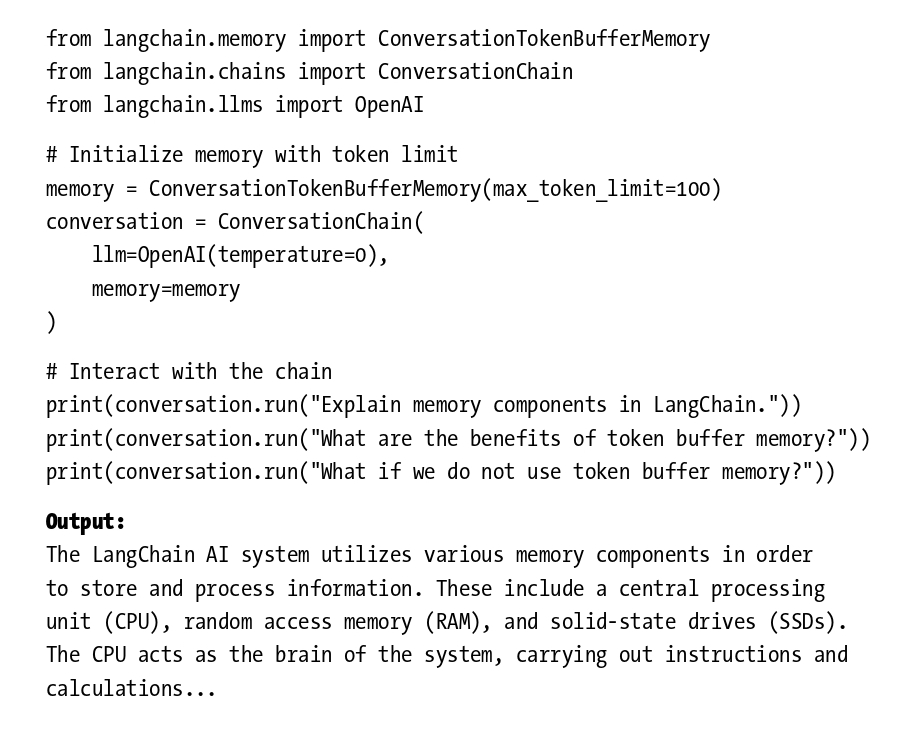

Code minh họa làm cách nào sử dụng LangChain’s ConversationTokenBufferMemory, cái giới hạn ghi nhớ trao đổi trò

chuyện thành 100 tokens, đảm bảo duy trì bối cảnh ngắn gọn. Một ConversationChain với OpenAI’s LLM làm có thể

các hội thoại tương tác, sử dụng ghi nhớ cho các trả lời nhận biết bối cảnh.